|

ouça este conteúdo

|

readme

|

Por Brasil de Fato

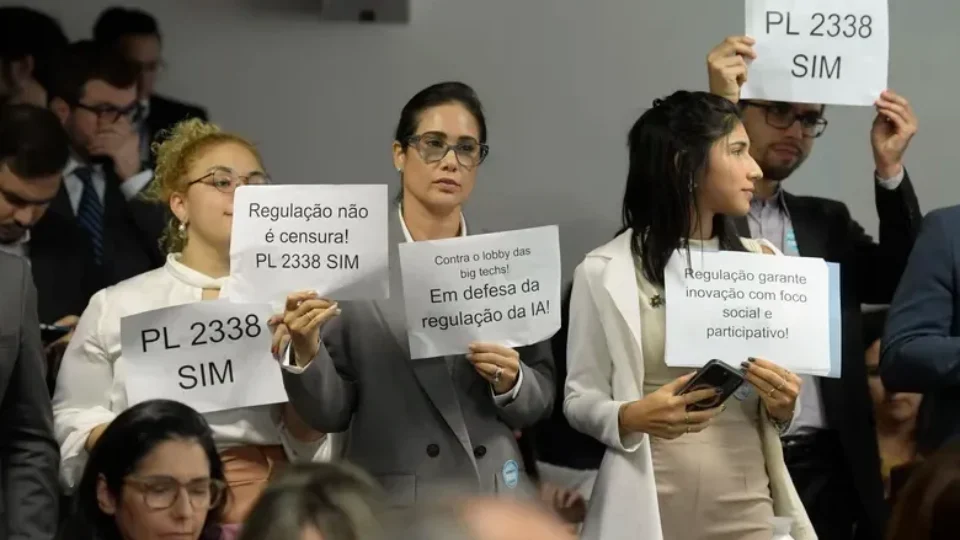

Após meses suspensa, deverá ser retomada, nesta terça-feira (3), no Senado, a análise do Projeto de Lei (PL) 2.338/2023, que estabelece o marco legal para o uso de Inteligência Artificial (IA) no Brasil. Apesar de ser encarada como pauta prioritária do Legislativo, a medida enfrenta resistência de setores como a Confederação Nacional da Indústria (CNI), além de plataformas digitais como Google e Meta, a empresa detentora do Facebook, do Instagram e do WhatsApp.

A nova data de votação do relatório final pela comissão temporária que analisa a proposta foi definida na última quinta-feira (28), quando o relator do projeto, o senador Eduardo Gomes (PL-TO), apresentou nova versão do texto. Se aprovado pelo colegiado, o PL pode ser levado a plenário nesta semana. De acordo com Gomes, o novo texto traz equilíbrio entre a preservação de direitos fundamentais e a garantia de condições para o desenvolvimento tecnológico.

Inicialmente prevista para julho deste ano, a votação foi adiada por decisão do presidente da Comissão Temporária Interna sobre Inteligência Artificial (CTIA), o senador Carlos Viana (Podemos-MG). De autoria do presidente do Senado, Rodrigo Pacheco (PSD-MG), o projeto estabelece normas nacionais para o desenvolvimento e uso de sistemas de Inteligência Artificial. O texto ainda seguirá para votação na Câmara dos Deputados caso seja aprovado pelos senadores.

Principais debates sobre Inteligência Artificial

Modelo racista de reconhecimento facial

A proposta tem estimulado debates que vão além do aspecto técnico, envolvendo questões sociais e políticas. Diretor do Instituto de Pesquisa em Direito e Tecnologia do Recife e integrante da Coalizão Direitos na Rede, André Fernandes ressalta avanços no texto, mas aponta lacunas em áreas críticas.

Exemplo de questões críticas seria o risco do reconhecimento facial por meio de sistemas de identificação biométrica à distância. Para Fernandes, o uso dessa tecnologia na segurança pública é especialmente perigoso para as populações negras e periféricas, visto que o modelo teria por base dados historicamente enviesados sob uma perspectiva racista.

Sistemas segurança baseados em reconhecimento facial podem ter viés racista (Foto: Rovena Rosa/Agência Brasil)

“Esse modelo é treinado com base em dados com pouca representação, e a própria tentativa de criar um banco de dados mais diverso — que poderia atenuar esses vieses raciais — é muito custosa e muito demorada. Para se ter uma ideia, dados de sistemas de reconhecimento facial atuais foram coletados na década de 1970 ou antes ainda”, ressalta. Para Fernandes, a aplicação de ferramentas como o reconhecimento facial deve se restringir a casos autorizados judicialmente e com fundamentação legal.

Também gera preocupação o uso de inteligência artificial em investigações criminais e na segurança pública. Fernandes critica a lógica punitivista que norteia essas aplicações e aponta os riscos de sistemas que ranqueiam pessoas com base em pontuações de risco.

“Usar Inteligência Artificial para avaliar risco de crime é um desastre. O conjunto de códigos que estrutura esse sistema de IA não necessariamente entrega os elementos técnicos necessários para a gente ter certeza [sobre o que está sendo investigado]”.

Fernandes cita como exemplo as falhas cometidas pelo Compas, uma ferramenta digital que foi usada no estado americano de Wisconsin para quantificar o suposto grau de periculosidade de alguém a partir das respostas dadas por essa pessoa. Em 2013, por exemplo, um juiz daquele estado usou a pontuação de risco gerada pelo Compas para impor prisão de seis anos a Eric Loomis, um homem negro, por ele ter fugido de uma abordagem policial.

Governança da Inteligência Artificial

Outro ponto destacado por Fernandes é a governança da IA e a concentração econômica no setor. Embora o projeto de lei traga diretrizes iniciais para segurança da informação, ele flexibiliza aspectos importantes, transformando em “boas práticas” o que deveriam ser normas obrigatórias.

“Os mecanismos de controle [presentes no projeto de lei] são parcialmente suficientes. Eles foram flexibilizados, muita coisa saiu do campo do ‘alto risco’, e muita coisa saiu do campo da ‘regra’ para as ‘boas práticas’. Ter boas práticas é importante, mas a gente tem muitos casos de danos que necessitam de uma governança mais robusta”, defende.

Quanto ao campo jornalístico, o pesquisador destaca que projeto de lei traz diretrizes iniciais, mas considera que o texto não chega a atacar o problema na raiz. “Ele [projeto de lei] traz as orientações de segurança da informação para a garantia da liberdade de expressão, o que nos dá um campo de trabalho para pensar políticas públicas”, avalia.

Relacionados

Inteligência Artificial do X admite alcance maior para perfis de extrema direita

Grok, a ferramenta da plataforma de Elon Musk, afirma que "o algoritmo do X favorece contas de extrema direita"

Inteligência Artificial elenca as cinco carreiras mais promissoras em 2025

Áreas mais promissoras são impulsionadas pela digitalização, automação e necessidade de inovação sustentável

Tese da defesa de Anderson Torres é desmontada por documentos do STF, Senado e Câmara

Documentos mostram que plano do ex-secretário de segurança do DF não previa emprego de forças como a Polícia Judicial e a Polícia Legislativa em 8 de janeiro